Hallo,

Dringende Hilfe gesucht- gibt's eine Möglichkeit eine komplette Website vom Webarchive runterzuladen, ohne langwierig jede Seite einzeln speichern zu müssen?

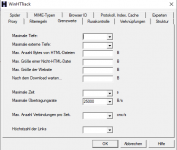

Ich habe mir httrack runtergeladen, nur leider komme ich damit nicht ganz klar.

ich hatte immer das Gefühl, dass ich mit meinen Einstellungen das gesamte Internet downloade.

Falls jemand die Seite nicht kennt:*

Bin über jeden Tipp dankbar.

Mfg Lilith

Dringende Hilfe gesucht- gibt's eine Möglichkeit eine komplette Website vom Webarchive runterzuladen, ohne langwierig jede Seite einzeln speichern zu müssen?

Ich habe mir httrack runtergeladen, nur leider komme ich damit nicht ganz klar.

ich hatte immer das Gefühl, dass ich mit meinen Einstellungen das gesamte Internet downloade.

Falls jemand die Seite nicht kennt:*

You do not have permission to view link please Anmelden or Registrieren

Bin über jeden Tipp dankbar.

Mfg Lilith